2014年,麻省理工學院媒體實驗室的研究者設計一項名為「道德機器」的實驗。他們的想法是打造類似一個遊戲的平台,讓參與者共同決定自動駕駛的無人車應該如何應對現實生活的「電車問題」。在過程中所產生的數據,也反映出不同文化的道德觀。

研究者從未預料實驗會受到廣大網友的回應。這個平台上線四年後,共有233個國家或地區的數百萬參與者,做出超過4000萬個決定,成為迄今為止關於全球道德偏好最多參與者的研究之一。發表在《自然》(Nature)期刊的新論文對實驗數據進行分析,揭示了文化、經濟與地理位置的道德觀差異。

經典的電車問題是這樣:當你看見一輛失控的列車在鐵軌上奔馳即將撞死五個人,這時你可以選擇拉操縱杆改變列車軌道,但如果切換到備用軌道就必須撞死另一個無辜的人。所以,你會選擇犧牲一個人以挽救另外五個人嗎?

道德機器以此為基礎提出九種不同的對象,對象的不同也讓參與者的決定有所改變:自動駕駛的無人車是否應該將人置於寵物之上?乘客是否置於行人之上?是否應該挽救更多的生命來犧牲少數人?女性是否置於男性之上?年輕人是否置於老年人之上?將健康的人置於病患之上?更高社經地位的人置於較低的社經地位的人之上?守法者是否置於違法者之上?最後,汽車應該轉向(採取行動)還是順其自然保持原路行駛(不採取行動)?

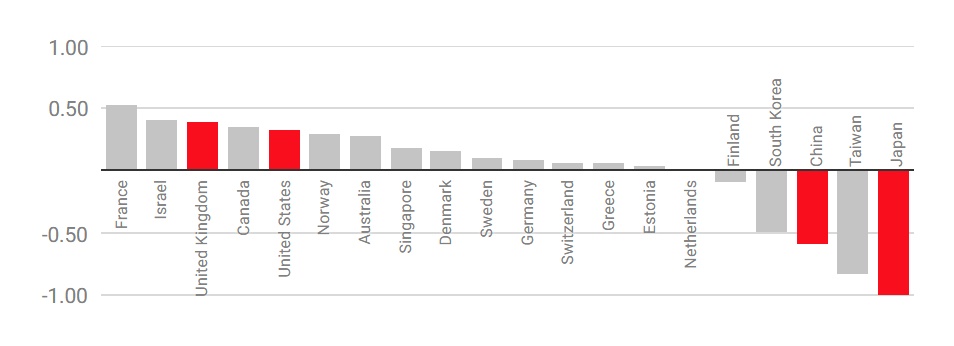

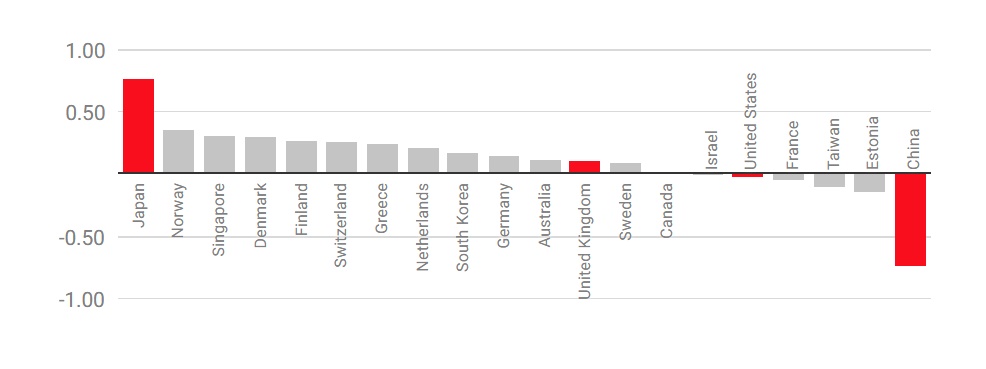

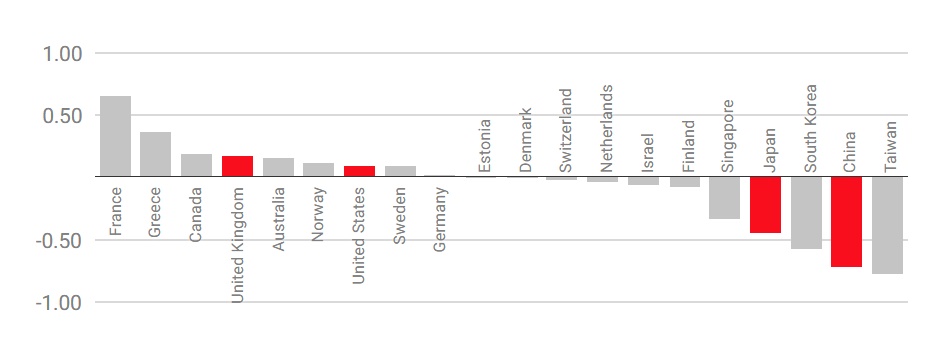

然而,這項實驗並不是進行一對一的比較,而是提供參與者各種組合的可能性,例如無人車是應該繼續直行撞死三名老年的行人,還是應該轉向撞死三名年輕的乘客。研究結果發現,各國的道德偏好差異非常大,似乎與文化和經濟發展相關。舉例來說,中國與日本較為集體主義文化的參與者不太可能替年輕人想,通常選擇讓老年人活下來。研究者推測,這或許是文化讓他們更重視與尊重長輩。

同樣地,貧窮國家的參與者對於亂穿越馬路的行人更寬容。經濟不平等程度較高的國家的參與者,在看待社經地位高的人和社經地位低的人方面,也顯示出更大的差距。

回到電車問題的根本問題,研究者發現在選擇挽救哪個群體的時候,人數並不總是最關鍵的因素。結果顯示,出身個人主義文化的參與者(例如英國和美國)在各種情況下,更容易做出挽救更多生命的決定──研究作者認為,或許是因為這種文化更強調每一個人的價值。

地理位置鄰近的國家也表現出更相近的道德偏好:三個主要群體分別為西方、東方與南方。研究者表示,由於實驗的參與者皆為自由參加,因此他們更可能是擁有網路、社經地位中上、對科技瞭解的群體,研究結果可能不完全正確。

這項實驗對於目前正在開發測試的無人車具有重大意義,因為這些道德偏好可能會影響無人車的設計與後續監控。例如,製造商可能會發現,中國的消費者更傾向於乘坐一輛可以保護自己免受行人傷害的汽車。

研究作者強調,這個結果並不是要決定各國應該如何抉擇。事實上,他認為研發人員與政策制定者的意見應該淩駕於公眾的集體意見之上,研究作者艾德蒙‧阿瓦德(Edmond Awad)提出社經地位高低作為例子,他說:「人們很多時候會選擇讓社經地位高的人活下來,而讓低社經地位者喪失生命,這情況讓人擔憂。重要的是,本研究顯示公眾想法確實『可以量化』並作為參考,但絕不表示『我們一定要照做』。」簡單來說,這個實驗結果應該被工業界與政府當作理解公眾對不同設計與政策的道德反應的「參考」。

阿瓦德希望實驗結果能幫助設計者更多思考與無人車有關的人工智慧道德問題,他說:「我們以電車問題為基礎,因為這是一種很容易蒐集數據的方法,但我們希望關於道德的辯論不要只侷限在這個主題之內,而是應該轉向風險分析——關於誰面臨的風險較大或較小——而不是誰被撞一定得死或一定不會死,以及了解道德偏見的根源。」他希望未來有更多研究把實驗結果轉化成更合乎道德的人工智慧設計與監控機制。

他說:「在過去兩三年內,越來越多人開始探討人工智慧的道德問題,越來越多人開始意識到,人工智慧可能對不同群體的人做出不同的道德結果。事實上,我們看見公眾參與其中,我認為這是一個好的發展。」

最新文章

最新文章 主題總覽

主題總覽 成為粉絲

成為粉絲 追蹤IG

追蹤IG 追蹤推特

追蹤推特 也有串串

也有串串 合作提案

合作提案