底下這張照片或許帶給你一絲不安,而你絕非唯一一個這樣想的人──如果你也知道他的頭蓋骨開了一個孔才能插進那個裝置的話。

圖片中顯示的是世界上第一個採用頭骨植入物來取代視網膜功用的藝術家,來自加泰隆尼亞的Neil Harbisson。天生色盲的他,渴望分辨顏色,因此透過外科手術在頭骨上植入像是天線的裝置,把光線照到的色彩轉換成「聲音」傳遞到腦裡,副作用是有時候會頭痛要吃止痛藥。

文|Bruno Martin

近幾十年來,神經科技已經從基礎的大腦成像技術發展成一門複雜的領域,重點專注在觀察與控制大腦。這個研究領域正進入全新未知的階段,科幻小說的測心術和心靈感應可能成為現實。在Facebook等科技巨頭加入建立腦機介面的競賽之際,專家呼籲對神經科技的道德面展開辯論,警告人們不要對新技術過度樂觀——因為問題不再是我們能做什麼,而是我們應該怎麼做。

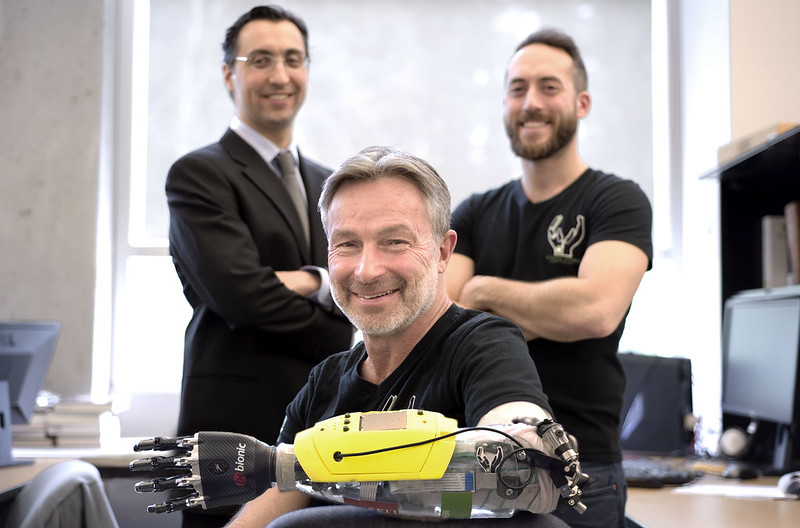

由埃隆‧馬斯克(Elon Musk)創立、微軟部分出資的美國公司「Neuralink」有個野心勃勃的計畫,透過為大腦植入細線將人類思想與網路連結。Neuralink最初的目標是將這種腦機介面應用在治療——例如,截肢者能自由控制仿生義肢——但他們的長期目標是希望提升人類能力,以實現「與人工智慧共生」。

Neuralink計畫在2020年中對人體進行首次實驗,而「超人類」計畫如果成功的話,還需要更長時間才能廣泛應用。然而,現在已經是思考這些計畫可能對人類大腦產生哪些副作用的時候了:人們會不會變得容易受到大腦駭客攻擊?或者破壞個人神經數據?會不會導致性格改變?這些都是瑞士蘇黎世聯邦理工學院生物倫理學家馬塞洛‧伊恩卡(Marcello Ienca)所稱的「神經資本主義」時代的現實問題。

一些分析人士認為,投資者誇大了神經科技的未來,因為他們仍然缺乏實現短期目標所需的神經科學知識與非侵入性技術。然而,這些目標並不是科幻小說想像:近年在神經行銷(neuromarketing)或神經遊戲(neurogaming)方面的進展,證明了該領域驚人的發展速度——而且速度只會隨著大公司的巨額投資而變快。

2019年,Facebook宣佈與加州大學舊金山分校合作的第一項成果:聲音解碼器的開發,它可以透過分析神經元來破譯簡單的通訊。該研究招募了準備進行侵入性手術的癲癇患者,透過植入物科學家能讀懂病患的想法,並從「你更喜歡聆聽哪種樂器」的幾種可能選項中分辨出答案。

從科學和技術角度來看,這些結果具有前景;但從社會角度來看,有些問題令人憂心的問題。在該研究發表的幾周前,美國聯邦貿易委員會(FTC)對Facebook處以50億美元的罰款,原因是他們允許諮詢公司劍橋分析(Cambridge Analytica)在未經使用者同意的情況下,對使用者進行政治型態分析。

如果使用者允許這些公司讀取大腦,那是不是就完全沒有隱私或安全保障呢?目前的情況確實是這樣——這也是專家警告的問題。杜克大學神經倫理學教授尼塔‧法拉哈尼(Nita Farahany)受訪時說:「對我來說,大腦是思想自由、想像自由和異議自由的安全之地。在沒有任何保護措施的情況下,我們即將跨越隱私的最後界線。」

馬塞洛‧伊恩卡和哥倫比亞大學神經科學家拉斐爾‧尤斯特(Rafael Yuste)這些專家也認為:政治和倫理方面的辯論落後於技術發展的速度。他們敦促科學家、技術人員和決策者預測可能的風險,並起草具體的法案。在他們看來,一系列涉及神經科學的事物應該受法律保障,以保護使用者的權利,並引導科技朝向對全人類有益的未來發展。

伊恩卡和同事羅伯托‧安德諾(Roberto Andorno)發表在學術期刊《生命科學、社會與政策》(Life Sciences, Society and Policy)的文章,為神經科技的新時代提出了四項新的人權:首先是認知自由權,例如當雇主或政府要求時,它允許人們自由決定是否選擇使用新的腦機介面;第二,精神隱私權,選擇何時以及在何種條件下共享神經數據,伊恩卡預見了竊聽思想、無意的自證其罪或買賣神經數據的可能性,這是自劍橋分析醜聞以來特別緊迫的問題。

第三,伊恩卡和安德諾提出了精神完整性的權利,保護使用者免受神經科技造成的身體或心理傷害;最後,心理延續性的權利,它為一個機器能夠未經事先同意竄改個體性格的世界裡,保障個體的人格同一性。尤斯特在哥倫比亞大學「神經權倡議」(NeuroRights Initiative)組織所提出的建議,與先前的建議大致相同,但又多加了另外兩項附加權利:平等獲得提升能力的權利,以及免受演算法偏見與歧視的權利。

尤斯特受訪時指出,道德責任首先在於像他這樣的技術專家和神經科學家,他們研究大腦如何運作,以及大腦如何被操控。尤斯特對神經科技在未來幾年可能達成的目標只有一個現實的看法,就是擔心未來讓人們措手不及,他說:「我們必須直指社會和政策制定者以避免濫用。我們擔負著歷史責任,身處在一個可以決定我們想要什麼樣未來的人類時代。」

原文出處:BBVA Openmind

最新文章

最新文章 主題總覽

主題總覽 成為粉絲

成為粉絲 追蹤IG

追蹤IG 追蹤推特

追蹤推特 也有串串

也有串串 合作提案

合作提案